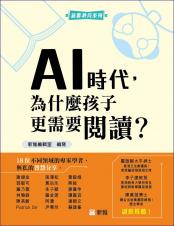

引言:當教育失去「摩擦力」

在當今的教育體系中,教師與家長們正集體陷入一種前所未有的焦慮。普遍學生的學業表現下滑、注意力碎片化,以及對深奧知識的排斥,已成為全球性的現象。與此同時,生成式人工智慧的強勢介入,讓獲取答案變得前所未有的輕鬆,用戶只需輸入一個指令,複雜的論文、精準的代碼或是數學題的解法便能瞬間生成。

在這樣的背景下,一股「回歸古典」或者「向高難度挑戰」的浪潮應運而生。以美國國防部長皮特‧海格塞斯(Pete Hegseth)與聖母大學哲學教授梅根‧蘇利文(Meghan Sullivan)為代表的評論家,主張重新引入拉丁文或微積分等傳統上被認為「艱深且無用」的學科。他們認為,教育之目的在於透過高度心智挑戰來培養學生的「沉思」(Contemplation)能力。然而,這種主張究竟是挽救認知危機的良藥,還是一種建立在統計誤讀上的懷舊情懷呢?

海格塞斯的「古典藥方」:拉丁文與學術優勢

在《美國心靈之戰:剷除一世紀的錯誤教育》(Battle for the American Mind: Uprooting a Century of Miseducation)一書中,海格塞斯猛烈抨擊現代世俗教育、自由派教育,他推崇的是一種「古典基督教教育」(Classical Christian Education),而拉丁文則是其課程核心之一。

海格塞斯指出,雖然拉丁文常被戲稱為「死語言」,但它是西方文明的根基。更重要的是,他提出了一個極具吸引力的實證數據:學習拉丁文的學生在SAT(美國大學入學考試)中的表現,通常比未學習者高出 100 分以上。很多古典教育支持者主張,拉丁文這種結構嚴密、語法複雜的語言,能有效地「鍛鍊」大腦,提升邏輯推理與詞彙解碼能力。在他們看來,這不單是學習一種語言,更是一種類似於「心智舉重」的過程,能讓學生在面對其他學術挑戰時更具競爭力。

蘇利文的哲學辯護:微積分與沉思的價值

聖母大學哲學教授蘇利文則從另一個角度強化了這一論點。在今年3月24日加拿大維真學院(Regent College)舉辦的倫理講座中,蘇利文坦承在自己的哲學研究與教學工作裏面,學生時代學過的微積分幾乎毫無用處。然而,她卻堅信這門學科的價值。蘇利文認為,微積分之所以重要,正是因為它難,這種難度迫使學生必須付出極高的注意力和長時間的沉思,這正是現代生活最稀缺的品質。

蘇利文憂心忡忡地指出,當今的技術環境(尤其是人工智能)正在有系統地剝奪人類的沉思空間。當工具讓一切變得太過容易,學生便失去了與複雜問題「搏鬥」的機會。她認為,教育的本質應該是引導學生進入一種深刻的思考狀態,而像微積分這樣具有高度心智需求的學科,正是通往沉思聖殿的門徑。

數據背後的真相:虛假相關與選擇偏誤

面對海格塞斯提出的「SAT高分」神話,我們必須以科學的嚴謹性進行拆解。統計學中有一句名言:「相關性並不必然引申出因果關係」(Correlation does not necessarily imply causation)。學習拉丁文與高學術表現之間的聯繫,極大可能是一種虛假相關(Spurious Correlation)。

這些數據存在着選擇偏誤(Selection Bias)的問題,會去選修拉丁文或進入古典基督教學校的學生,通常來自於更重視教育、經濟實力更雄厚的家庭。這些學生在接觸拉丁文之前,就已經具備了較高的基線認知能力與家庭資源支持。換句話說,並不是拉丁文讓他們變聰明,而是那些本身聰明且資源豐富的學生,更有可能出現在拉丁文的課堂上。此外,社會經濟地位是SAT分數最強大的預測指標。如果我們控制了家庭收入、父母教育程度等變數,拉丁文帶來的所謂「分數優勢」往往會迅速萎縮,甚至消失。

唯一路徑的謬誤:心智訓練的多樣性

古典和高難度教育擁護者的邏輯,本質上是十八世紀「官能心理學」(Faculty Psychology)的現代復興。這一學派將人類的心智想像成一組由不同「官能」所組成的機器,如記憶、推理、意志、注意力與想像。在這種觀點下,大腦被賦予了一個極其直接的比喻:肌肉。正如舉重能強化二頭肌,官能心理學主張,透過接觸極度艱深的學科,可以整體性地強化心智的「推理肌肉」或「記憶肌肉」。

這種理論直接催生了教育史上的「形式訓練說」(Formal Discipline),其核心教條是:教育的價值不在於學科的「內容」,而是在於「形式」。因此,拉丁文的變格、幾何的證明、或是複雜的微積分,被視為心智的「健身房」。

然而,這種「心智舉重」的理論在二十世紀初便遭到了心理學界嚴厲的科學修正。實驗心理學先驅桑代克(Edward Thorndike)透過一系列研究證明,不同領域之間的學習遷移(Transfer of Learning)是有限制的。他提出「相同元素論」(Identical Elements Theory):一個人在拉丁文課堂上訓練出的邏輯能力,並不會自發性地轉移到商業決策或社會互動中,除非兩者之間存在高度重疊的具體元素。同樣道理,熟悉微積分會令你更有能力解決數學問題或者編碼,但它不會幫助你吟詩作對。這解釋了為什麼社會上有很多「聰明笨伯」,一個在某領域上登峰造極的博士、教授,可能理財完全無方,對政治時局分析一塌糊塗,甚至生活的常識都一竅不通。

訓練「沉思」與「專注」並沒有所謂的「唯一路徑」。如果一個學生對古羅馬歷史、天主教神學、西方古典經典毫無興趣,強迫他背誦拉丁文變格可能只會導致挫敗感與厭學情緒,而非深度的沉思。這也解釋了為什麼有些自小被迫學習彈鋼琴的兒童,長大後對音樂敬而遠之。

其實,許多現代學科同樣具備極高的心智需求,例如編寫複雜的 C++ 或 Java 程式、推導量子物理公式,或是進行嚴謹的歷史文本互校。這些學科同樣需要「心智舉重」,且具備更高的現實連結性。

認知的危機:當人工智能帶走了「合意的困難」

雖然我質疑微積分的特殊地位,但古典教育強調的紀律性與長時間專注,確實在某些學習情境中具有價值,而且,蘇利文對「人工智能讓學習變得太容易」的擔憂卻是非常精準的。在教育心理學中,這涉及到兩個互補的核心概念:羅伯特‧比約克(Robert Bjork)提出的「合意的困難」(Desirable Difficulty),以及心理學家維高斯基(Lev Vygotsky)著名的「近側發展區間」(Zone of Proximal Development, ZPD)。

「合意的困難」指出,當大腦在學習過程中遇到適度的阻力與挫折時,神經連結才會更加深刻。而維高斯基則進一步定義了這種「難度」的精確範圍:學習不應發生在學生已熟練的「已知區」,也不應發生在令其絕望的「不可及區」,而應發生在那個「獨自無法完成,但在適度引導下可以達成的「ZPD甜點區」。在這個區域內,學生必須進行深度的尋索和犯錯,這正是沉思力與注意力被喚醒的時刻。

然而,人工智能的介入正在消除這種必要的摩擦力和甜點區。當學生遇到數學難題,大型語言模型會直接給出過程;當需要撰寫報告,它會代為構思。這種「認知外包」(Cognitive Offloading)雖然提升了效率,卻有可能導致了心智的萎縮。如果教育完全去除了摩擦力,學生就像是在光滑冰面上行走的人,雖然速度很快,卻無法留下任何足跡。這種「認知退化」的風險是真實存在的,我們確實需要某種困難來錨定學生的注意力。

重新定義優質教育:有意義的難度

不過,我們不應在「易過借火」與「盲目追求高難度」這兩個極端之間跳躍。好的教育不應是強迫每個學生去鑽研對其毫無意義的「死語言」或「冷僻數學公式」,而是要確保每個學生都能在自己感興趣的領域中,找到那個能讓他們進入「心智激戰」的挑戰,這就是「有意義的難度」(Meaningful Rigor),所謂有意義的難度,是指難度與個體動機、情境與未來目標高度耦合的學習挑戰,舉例說:

- 對於醉心藝術的學生,挑戰應來自於拍攝鯨魚跳出水面轉身的照片,或者在鼻煙壺裏面繪製內畫。

- 對於志在神學或歷史的學生,學習希臘文或希伯來文以解釋聖經和閱讀原典,便是其沉思的磨刀石。

- 對於熱衷數據分析的學生,深奧的高等統計學、數據科學、機械學習則是訓練邏輯精準度的不二法門。

教育者的使命,是為學生找到那塊「值得為之流淚、流汗、流血」的磨刀石。我們必須對抗人工智能帶來的盲目便利,重新在課程中設計「有意義的難度」,但這種困難必須與學生的熱情與未來方向連結。