近月,全紅嬋被網暴的事件引起了廣泛關注。她在接受中國《人物》雜誌專訪時曾落淚,懇求外界停止對她及其家人的攻擊,而網民的評論亦影響到她的自我形象與日常生活,令她承受了巨大壓力。在社交媒體中,每人都可能成為被談論甚至攻擊的對象,不只是名人,當然名人較容易被看見,相關平台或執法部門也可能會較快介入制止。但此事值得家長詳加了解,因為它揭示了一種網絡暴力,不少青少年也可能正於數碼環境中承受著壓力與欺凌。

從榮耀到被圍攻

全紅嬋作為奧運金牌得主,自出道以來備受矚目。然而,隨著年齡增長與身體發育,她的外貌與體型變化成為部份網民攻擊的焦點。更有報道指有畸形「飯圈文化」形成網絡群組,長期對她進行侮辱與謾罵,甚至制定規則允許針對她進行攻擊(「禁止人身攻擊(除全紅嬋外)」)。這些言論不僅涉及外貌羞辱與中傷,還涉及對其人格尊嚴的踐踏,而且還波及家人朋友。[1]

全紅嬋接受雜誌訪問中懇求外界停止對她及其家人的攻擊,可見她所承受的心理壓力已幾達極限。事件曝光後,一個名為「水花征服者聯盟」的280多人微信私密群組對話截圖開始在微博等平台瘋傳,網民亦紛紛轉發截圖並強烈譴責。及後,培訓全紅嬋的廣東省二沙體育訓練中心向公安機關報警,當局迅速介入,拘留涉案群主並處罰相關人員,社會輿論亦普遍表達對她的同情與支持。

內地「飯圈」文化:捧殺與棒殺的兩極拉扯

說到內地的「飯圈文化」[2],原指粉絲圍繞偶像形成的社群,但隨著社交媒體的發展,其運作邏輯逐漸變得極端。全紅嬋所面對的「飯圈文化」,就是「造神」與「毁神」的兩極拉扯:在剛奪得冠軍時,人人稱她為「天才少女」;但到了因發育而導致技術狀態出現波動時,就惡言相向。

另外,在競爭劇烈的體育領域中,運動員不只是競技者,也會被賦予明星屬性。粉絲之間可能不會單純支持,會透過比較而形成「捧一踩一」的對立現象,以「維護偶像」為名,對其他運動員進行攻擊,將這種行為視為「忠粉」表現。而社交平台的演算法偏好爭議與衝突,使極端言論更易傳播,容易進一步激化網民情緒,失去理性判斷。

社交媒體對青少年的身心影響

從全紅嬋這個案例來看,對家長而言,更值得關注的,是這種網絡生態對發育及成長中青少年的影響。十多歲的青少年,根據艾瑞克森(Erik Erikson)的心理社會發展理論,正處於尋找自我認同,探索「我是誰」的關鍵階段,對外界有關自己的評價極為敏感。當他們長期接觸充滿比較、批評甚至羞辱的內容時,容易產生焦慮與自卑,有可能會陷入迷惘與角色混淆,未能確立人生目標和價值觀。

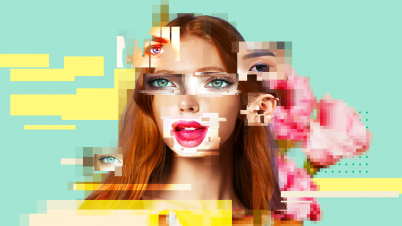

全紅嬋因體型變化而受到攻擊,正反映出社會對外貌的單一標準,這種標準會被青少年內化,有可能會影響其自我價值。當「被看見」與「被認可」掛鈎,青少年可能會逐漸忽視現實生活上的真實需要及自我感受,轉而為了獲得關注及迎合主流審美與評論。當自我價值建立在外界回應上時,遭遇負評便會容易陷入情緒波動。

應對網絡討論文化與年齡限制的思考

幸好,內地主流媒體與社會輿論普遍仍會呼籲抵制畸形的「飯圈文化」,強調理性支持、同理心及尊重,網絡言論應有界線及負責任。因此,網民應藉由培養網絡素養及建立理性的討論文化,意識到其言論會對所評論的人產生影響,在發表意見前,應思考其必要性與後果,亦應知道要負責任。如見到不當言論或網絡欺凌,網民亦可善用平台的舉報機制,以阻止事件惡化。

而對於社交媒體使用設立年齡限制,近期多國已開始實施及探討如何作出限制及保護青少年,這的確是一個值得審慎討論的問題。青少年在心理與認知上尚未成熟,較易受外界影響,適當的年齡門檻或分級制度,將有助於降低風險。

總括而言,培養網民(不單是青少年)的媒體素養教育,讓他們理解網絡信息的運作方式、學習辨識偏見與操控,並培養同理心與自我保護能力是極為重要的。全紅嬋的經歷提醒我們,即使是為國爭光的金牌得主,也難以避免受到網絡暴力的傷害。對香港家長而言,這不單並非遙遠的個案,更是一面鏡子,反映出網絡暴力如何給青少年造成壓力及負面影響。社交媒體應該是被善用來讓大家互相溝通,而不應成為造成心靈傷害的平台。

[1]朱浙萍︰〈捧殺棒殺映射病態網絡文化〉,《浙江日報》,2026年4月8日,網站:https://zjrb.zjol.com.cn/html/2026-04/09/content_3895791.htm?div=-1

[2]「飯圈文化」:飯圈是網路用語,指粉絲圈子。「飯」源自英文「fans」的音譯。分析指出,飯圈文化只是表象,背後反映的是中國競技體育系統資源的高度集中性與競爭的激烈性。(摘自中央社2026年4月13日報導)